Einführung in Generative KI und Large Language Models (LLMs) für Tester

In der dynamischen Welt der Softwaretests bieten generative KI und insbesondere Large Language Models (LLMs) neue Chancen für effizientere und intelligentere Testprozesse. Ob Sie manuell testen oder automatisieren – das Verständnis dieser Technologien wird zunehmend zur Schlüsselkompetenz. Dieser Artikel führt Sie durch die Grundlagen und zeigt erste praktische Anwendungen.

Was sind LLMs?

Large Language Models sind neuronale Netzwerke, die Sprache verstehen und erzeugen können. Anders als regelbasierte Systeme arbeiten sie muster- und datengetrieben.

Kernbestandteile moderner LLMs:

- Transformer-Architektur: Erlaubt es, Wortbedeutungen im Kontext zu erfassen (Stichwort: "Attention").

- Parameter: Milliarden kleiner Zahlen, die das erlernte Wissen speichern.

- Tokenisierung: Zerlegung von Text in kleine Einheiten, z. B. Wörter oder Silben.

- Training: Mehrstufiger Lernprozess: Vortraining, Feinabstimmung und menschliches Feedback (RLHF).

Was LLMs von traditioneller Software unterscheidet

Als Tester ist es wichtig zu verstehen, wie fundamental sich LLMs von herkömmlicher Software unterscheiden:

| Traditionelle Software | Large Language Models |

|---|---|

| Deterministisch | Probabilistisch |

| Regelbasiert | Musterbasiert |

| Explizite Programmierung | Implizites Lernen |

| Vorhersehbares Verhalten | Emergentes Verhalten |

| Direkte Kontrolle | Indirekte Steuerung |

Fazit für Tester: Neue Denkweise nötig – nicht alles ist exakt reproduzierbar.

Prompts: Wie man mit LLMs spricht

Die Interaktion mit LLMs erfolgt über "Prompts" – Texteingaben, die dem Modell mitteilen, was es tun soll. Prompt Engineering ist die Kunst, diese Eingaben so zu gestalten, dass sie optimale Ergebnisse liefern.

Prompt-Komponenten

Ein effektiver Prompt besteht typischerweise aus mehreren Elementen:

- Kontext: Hintergrundinformationen, die dem Modell helfen, die Anfrage einzuordnen

- Anweisung: Was das Modell konkret tun soll

- Eingabedaten: Spezifische Informationen, die verarbeitet werden sollen

- Ausgabeformat: Vorgaben zur Strukturierung der Antwort

Gutes vs. schlechtes Prompt

Schlecht:

Erstelle Testfälle.

Gut:

Erstelle 10 funktionale Testfälle für das Login-Formular einer Banking-App.

Berücksichtige Edge Cases, Validierungen und Sicherheitsaspekte.

Prompt-Techniken für Tester

Als Tester können Sie von verschiedenen Prompt-Techniken profitieren:

1. Rollenanweisung

Du bist ein erfahrener Senior-Softwaretester mit Expertise in API-Testing.

Analysiere die folgende API-Dokumentation und identifiziere potenzielle Testfälle,

die besonders fehleranfällige Bereiche abdecken:

[API-Dokumentation hier einfügen]

2. Chain-of-Thought (Gedankenkette)

Betrachte Schritt für Schritt die möglichen Testszenarien für eine

Benutzerregistrierung. Überlege, welche Edge Cases auftreten könnten,

welche Validierungen notwendig sind, und wie die Datenbankinteraktion

getestet werden sollte.

3. Few-Shot Learning (Beispielbasiertes Lernen)

Hier sind einige Beispiele für gute Testfälle:

Testfall 1: Überprüfung, ob ein Benutzer mit gültiger E-Mail und Passwort erstellt werden kann

Eingabe: gültige E-Mail, gültiges Passwort

Erwartetes Ergebnis: 201 Created, Benutzer in Datenbank vorhanden

Testfall 2: Überprüfung, ob ein Benutzer mit bereits existierender E-Mail abgelehnt wird

Eingabe: bereits registrierte E-Mail, gültiges Passwort

Erwartetes Ergebnis: 400 Bad Request, Fehlermeldung "E-Mail bereits registriert"

Erstelle nun ähnlich strukturierte Testfälle für die Passwort-Reset-Funktionalität.

Häufige Fehler im Prompt Engineering

- Zu vage Anweisungen: "Generiere Testfälle" statt "Generiere 10 API-Testfälle für das Benutzerlogin"

- Fehlender Kontext: Wichtige Informationen zur Anwendung werden nicht bereitgestellt

- Widersprüchliche Anforderungen: Unvereinbare Vorgaben verwirren das Modell

- Ignorieren von Modellgrenzen: Anfragen nach spezifischem Insider-Wissen, das nicht im Training enthalten war

Tools und Techniken rund um LLMs und VLMs

Neben reinen Textmodellen (LLMs) gewinnen auch Vision Language Models (VLMs) zunehmend an Bedeutung, die sowohl Text als auch Bilder verarbeiten können.

Populäre LLM-Plattformen für Tester

| Plattform | Stärken | Besonderheiten |

|---|---|---|

| ChatGPT (OpenAI) | Allgemeinwissen, Coding | API-Integration, GPTs |

| Claude (Anthropic) | Lange Kontextfenster, Dokumentenanalyse | Ethikfokus, Claude Opus für komplexe Aufgaben |

| Gemini (Google) | Multimodalität, Google-Integration | Starke mathematische Fähigkeiten |

| Llama (Meta) | Open Source, lokale Ausführung | Anpassbar, weniger Einschränkungen |

| Mixtral (Mistral AI) | Open Source, gutes Preis-Leistungs-Verhältnis | Sparse Mixture of Experts (SMoE) |

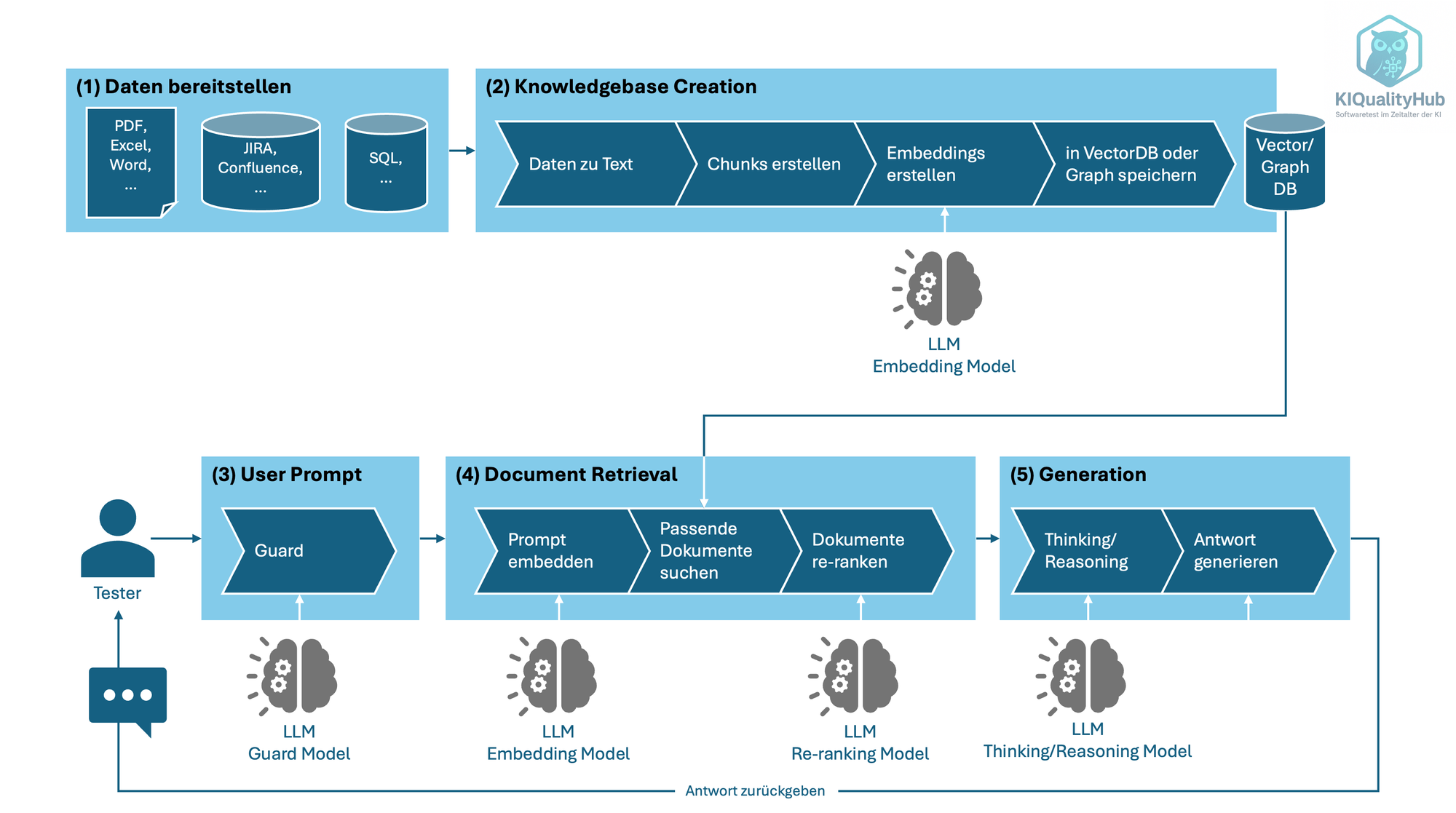

RAG: Wissen einbetten, statt raten lassen

**Retrieval-Augmented Generation (RAG)** bedeutet: LLM + Wissensdatenbank. Statt sich auf das Trainingswissen zu verlassen, holt das System gezielt relevante Infos aus eigenen Dokumenten.

**Vereinfachte Analogie:**

- LLM = schlaue Person, die schnell Texte schreibt

- RAG = diese Person bekommt vor dem Schreiben Zugriff auf Ihre Projektdokumentation

RAG-Komponenten

- Dokumentensammlung: Testdokumentation, Anforderungen, Bugdatenbanken etc.

- Chunking: Aufteilung langer Dokumente in verwaltbare Teile

- Embeddings: Umwandlung von Text in numerische Vektoren, die semantische Ähnlichkeit erfassen

- Vektordatenbank: Speicherung und schnelle Abfrage der Embeddings

- Retrieval-Komponente: Findet relevante Informationen basierend auf der aktuellen Anfrage

- Generation: LLM erzeugt Antworten basierend auf den abgerufenen Informationen

Vorteile von RAG für Testteams

- Aktualität: Zugriff auf die neuesten Testdokumente und Spezifikationen

- Genauigkeit: Reduzierte Halluzinationen durch Faktenverankerung

- Kontext: Berücksichtigung unternehmensspezifischer Prozesse und Standards

- Institutional Knowledge: Bewahrung und Nutzung des kollektiven Testwissens

KI-Agenten und Multi-Agent-Workflows im Testkontext

Neben klassischen LLM-Prompts gewinnen agentenbasierte Ansätze an Bedeutung. Hierbei übernehmen spezialisierte KI-Agenten einzelne Aufgaben innerhalb eines Testworkflows.

Beispielhafte Agentenrollen:

- Anforderungsanalyst: Extrahiert Testziele aus User Stories

- Testfalldesigner: Generiert strukturierten Testfallkatalog

- Datenagent: Erzeugt passende Testdaten

- Code-Reviewer: Analysiert Tests auf Qualität und Abdeckung

- Dokumentationsagent: Erstellt Management-gerechte Reports

Frameworks wie Autogen, CrewAI, Agno oder Langchain und LangGraph ermöglichen, solche Agenten zu orchestrieren – z. B. im Dialog oder als Workflowkette.

Erste Anwendungen im Bereich Softwaretest

Mit dem Grundlagenwissen ausgestattet, können wir nun konkrete Anwendungsfälle für LLMs im Softwaretest betrachten.

1. Testfallgenerierung und -verbesserung

LLMs können aus verschiedenen Eingaben Testfälle generieren:

Gegeben ist folgende User Story:

"Als registrierter Benutzer möchte ich mein Passwort zurücksetzen können, damit ich auf mein Konto zugreifen kann, wenn ich mein Passwort vergessen habe."

Generiere funktionale Testfälle, die folgende Aspekte abdecken:

- Happy Path

- Negative Szenarien

- Edge Cases

- Sicherheitsaspekte

- Benutzerfreundlichkeit

Das Ergebnis ist ein umfassender Satz von Testfällen, der als Ausgangspunkt dienen kann. Als menschlicher Tester bleibt Ihre Aufgabe, diese zu prüfen, anzupassen und zu priorisieren.

2. Code-Review und Bug-Identifikation

LLMs können Code analysieren und potenzielle Probleme aufdecken:

Überprüfe den folgenden Test-Code auf Qualitätsprobleme, Fehler und Verbesserungsmöglichkeiten:

[Test-Code hier einfügen]

Berücksichtige dabei:

- Testabdeckung

- Zuverlässigkeit (Flakiness)

- Wartbarkeit

- Best Practices

Die tatsächlichen Anforderungen und dokumentierte Best Practices können hierbei noch mehr Kontext geben und die Antwort damit deutlich verbessern.

3. Testdatengenerierung

LLMs können realistische Testdaten erstellen, die bestimmten Anforderungen entsprechen:

Erstelle einen JSON-Datensatz mit 5 Produkten für einen E-Commerce-Shop.

Jedes Produkt sollte folgende Attribute haben:

- id (UUID)

- name (realistischer Produktname)

- description (50-100 Wörter)

- price (zwischen 10 und 500 Euro)

- category (aus: Electronics, Clothing, Home, Books, Sports)

- tags (3-5 relevante Tags)

- inStock (boolean)

4. Dokumentation und Kommunikation

LLMs können bei der Erstellung und Verbesserung von Testdokumentation helfen:

Ich habe folgende Test-Ergebnisse:

[Testergebnisse hier einfügen]

Erstelle einen strukturierten Testbericht für das Management, der folgende Abschnitte enthält:

- Executive Summary

- Testumfang

- Wichtigste Ergebnisse

- Risikobereiche

- Empfehlungen

5. Explorative Tests

LLMs können als Ideengeber für explorative Testsitzungen dienen:

Ich führe explorative Tests für eine Banking-App durch. Schlage kreative Testszenarien vor,

die ungewöhnliche Benutzerinteraktionen, Grenzfälle und potenzielle Schwachstellen abdecken.

Berücksichtige dabei Aspekte wie Transaktionsverarbeitung, Kontomanagement, Sicherheit und

mobile Besonderheiten.

Herausforderungen und Einschränkungen

Bei aller Begeisterung für LLMs ist es wichtig, ihre Grenzen zu kennen:

- Halluzinationen: LLMs können plausibel klingende, aber falsche Informationen generieren

- Kontextbegrenzungen: Trotz Fortschritten haben LLMs begrenzte Kontextfenster

- Aktualität: Das Wissen von LLMs endet mit ihrem Trainingsdatum

- Sicherheit und Vertraulichkeit: Vorsicht bei der Weitergabe sensibler Testdaten

- Qualitätssicherung: LLM-Ausgaben müssen immer überprüft werden – sie ersetzen nicht das menschliche Urteilsvermögen

Der Tester der Zukunft: Mensch-KI-Kollaboration

LLMs und generative KI werden den Beruf des Testers nicht ersetzen, sondern transformieren. Die erfolgreichsten Tester werden diejenigen sein, die diese Technologien effektiv nutzen, um ihre Fähigkeiten zu erweitern.

Der "Prompt-Engineering-Tester" wird eine neue Schlüsselkompetenz entwickeln: die Fähigkeit, mit KI-Systemen so zu interagieren, dass sie optimale Ergebnisse für Testaufgaben liefern.

Erste Schritte für Tester

Wenn Sie als Tester mit LLMs und generativer KI beginnen möchten, empfehlen wir folgende Schritte:

- Praktische Erfahrung sammeln: Experimentieren Sie mit ChatGPT, Claude oder anderen frei zugänglichen LLMs

- Prompt-Engineering lernen: Üben Sie das Erstellen effektiver Prompts für Test-spezifische Aufgaben

- Integrationsmöglichkeiten erkunden: Identifizieren Sie Bereiche in Ihrem Testprozess, wo LLMs den größten Mehrwert bieten könnten

- Klein anfangen: Beginnen Sie mit einfachen Anwendungsfällen wie der Testfallerstellung oder Dokumentationsunterstützung

- Community-Austausch: Teilen Sie Ihre Erfahrungen mit anderen Testern und lernen Sie von deren Erkenntnissen

Fazit

Generative KI und Large Language Models stehen erst am Anfang ihrer Entwicklung, doch ihr Potenzial für die Softwaretestbranche ist bereits jetzt enorm. Als Tester bietet sich Ihnen die Chance, diese Revolution aktiv mitzugestalten.

Indem Sie das Verständnis der zugrundeliegenden Technologien mit Ihrer Testexpertise kombinieren, können Sie nicht nur Ihre eigene Produktivität steigern, sondern auch völlig neue Testansätze entwickeln. Die Zukunft gehört den Testern, die die Stärken von KI nutzen, um sich auf die wirklich wertvollen Aspekte des Testens zu konzentrieren: kritisches Denken, kreative Problemlösung und das tiefe Verständnis der Benutzerbedürfnisse.

Dieser Artikel ist Teil unserer Serie "Testen im Zeitalter der Künstlichen Intelligenz". Im nächsten Beitrag werden wir uns mit praktischen Beispielen zur Implementierung von KI-gestützten Testautomatisierungslösungen beschäftigen. Folgen Sie KIQualityHub, um keine neuen Beiträge zu verpassen.